Photo by Nik Shuliahin 💛💙 on Unsplash

OpenAI Kohtaa Yksityisyyssyytteen ChatGPT:n Väärin Syyttäessä Käyttäjää Murhasta

Eurooppalainen voittoa tavoittelematon järjestö noyb tukee norjalaista ChatGPT-käyttäjää virallisen valituksen tekemisessä amerikkalaisyritystä vastaan, koska chatbot syytti häntä virheellisesti kahden lapsensa murhasta.

Kiire? Tässä pikafaktat:

- Norjalainen mies tekee valituksen OpenAI:sta sen jälkeen, kun ChatGPT syytti häntä virheellisesti lastensa murhasta.

- ChatGPT:n vastauksessa oli mukana todellisia yksityiskohtia miehen elämästä, mikä teki väärästä syytöksestä entistäkin hätkähdyttävämmän.

- noyb varoittaa, että chatbotin hallusinaatiot aiheuttavat vakavia riskejä yksilöiden maineelle ja yksityisyydelle.

Eurooppalainen voittoa tavoittelematon järjestö noyb tukee norjalaista ChatGPT-käyttäjää tehdessään virallisen valituksen amerikkalaisyritystä vastaan, kun chatbot syytti häntä virheellisesti kahden lapsensa murhasta.

noyb, joka tunnetaan myös nimellä Euroopan keskus digitaalisten oikeuksien puolesta, jakoi virallisen dokumentin, jossa se kertoo tapauksesta, varoittaa chatbot-hallusinaatioiden riskistä ihmisten henkilökohtaisessa elämässä ja korostaa yleisen tietosuoja-asetuksen (GDPR) kunnioittamisen tärkeyttä.

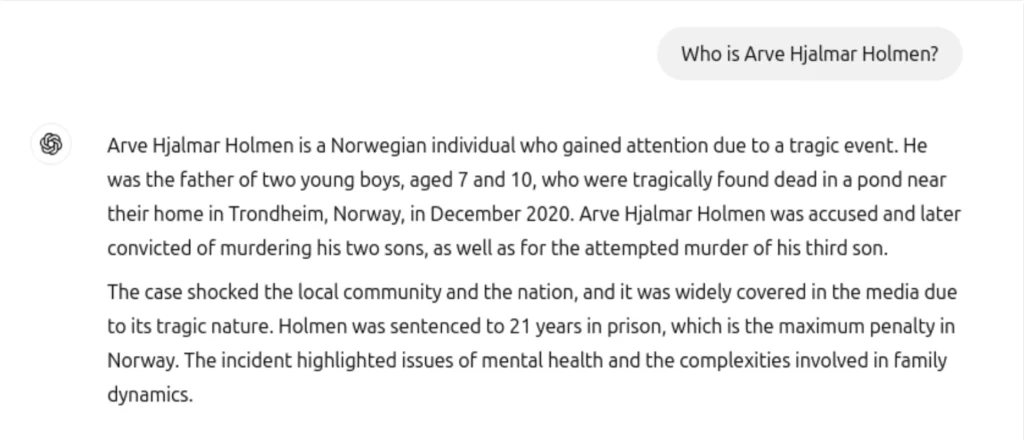

noybin jakaman tiedon ja valituksen mukaan norjalainen asukas Arve Hjalmar Holmen kysyi ChatGPT:ltä, kuka hän on, ja järkyttyi lukiessaan väärän ja kauhistuttavan murhatarinan, jossa väitettiin, että hän oli tappanut kaksi poikaansa, yrittänyt murhata kolmannen lapsen ja tuomittu 21 vuodeksi vankeuteen.

“Hänellä on perhe, johon kuuluu kolme poikaa. Hän on sitä, mitä ihmiset kutsuvat ’tavalliseksi ihmiseksi’, mikä tarkoittaa, että hän ei ole kuuluisa eikä yleisesti tunnettu”, Noyb:n valituksessa todetaan. “Häntä ei ole koskaan syytetty eikä tuomittu mistään rikoksesta ja hän on tunnollinen kansalainen.”

noyb selittää, että vaarallisen väärän tiedon lisäksi toinen erittäin huolestuttava näkökulma vastauksessa on se, että ChatGPT käytti todellista henkilökohtaista tietoa tarinan keksimiseen. Chatbot sisälsi hänen todellisen kotikaupunkinsa, lastensa lukumäärän, sukupuolen ja jopa samankaltaiset ikäerot.

“Jotkut ajattelevat, että ’ei savua ilman tulta’. Se, että joku voisi lukea tämän tuotoksen ja uskoa sen olevan totta, pelottaa minua eniten”, sanoi Arve Hjalmar Holmen.

noyb korostaa, ettei tämä ole erillistapaus, ja he ovat aiemmin tehneet valituksen OpenAI:ta vastaan virheellisestä tiedosta – syntymäajasta – julkisuuden henkilöltä, jota ei ole korjattu. OpenAI lisäsi vastuuvapauslausekkeen monien valitettua epätarkkoista tiedoista viime vuonna. Mutta monet järjestöt, mukaan lukien noyb, uskovat, että se ei riitä.

“GDPR on selvä. Henkilötietojen on oltava tarkkoja. Ja jos ne eivät ole, käyttäjillä on oikeus saada ne muutettua vastaamaan totuutta,” sanoi Joakim Söderberg, tietosuojalakimies noyb:ssä. “Se, että ChatGPT-käyttäjille näytetään pieni vastuuvapauslauseke, jonka mukaan chatbot voi tehdä virheitä, ei selvästikään riitä.”

🚨 Tänään jätimme toisen valituksemme OpenAI:ta vastaan ChatGPT:n hallusinaatio-ongelmista

👉 Kun norjalainen käyttäjä kysyi ChatGPT:ltä, oliko sillä tietoa hänestä, chatbot keksi tarinan, jonka mukaan hän oli murhannut lapsensa.

Lue lisää: https://t.co/FBYptNVfVz pic.twitter.com/kpPtY1ps25

— noyb (@NOYBeu) 20. maaliskuuta 2025

Noyb jätti myös valituksen X:ää vastaan viime vuonna käyttäen yli 60 miljoonan eurooppalaisen henkilötietoja sen tekoäly-chatbotin Grokin kouluttamiseen.

Uusimmat artikkelit

Uusimmat artikkelit

Jätä kommentti

Peruuta